Fonctionnement

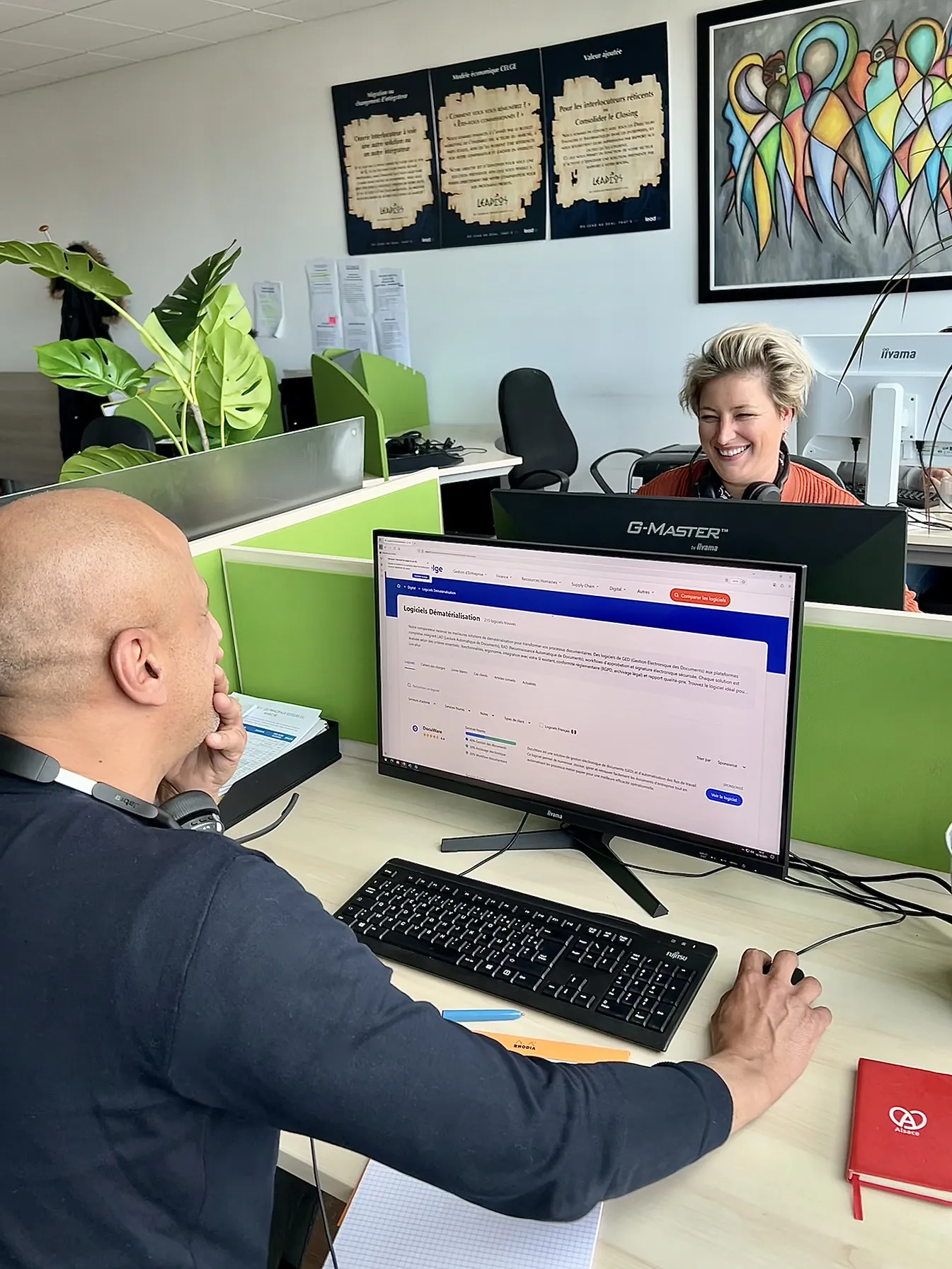

Notre équipe vous contacte pour discuter des détails et garantir une solution parfaitement adaptée à votre projet.

Notre équipe d'experts vous accompagne et vous propose les meilleures options selon vos besoins.

Nous vous proposons des options personnalisées qui correspondent parfaitement à vos besoins en logiciels.

Notre équipe d'experts en logiciels se consacre à vous guider tout au long du processus de sélection des logiciels. Vous recevrez des recommandations sur mesure dans un délai de 1 à 2 jours.

L'audit par un expert et la recherche sont gratuits

Une expertise logicielle forgée depuis 15 ans

Le meilleur logiciel trouvé en moins de 48 heures.

Celge est une entreprise 100% indépendante.

Nos experts sont à votre disposition pour effectuer un audit gratuit et évaluer vos besoins spécifiques. Notre objectif est d'identifier les solutions logicielles idéales et adaptées à vos besoins.

Faire un audit gratuit

100% gratuit 15 ans d'expérience logicielle Réponse en moins de 48 heures Impartial 40 000+ entreprises accompagnées

100% gratuit 15 ans d'expérience logicielle Réponse en moins de 48 heures Impartial 40 000+ entreprises accompagnées

100% gratuit 15 ans d'expérience logicielle Réponse en moins de 48 heures Impartial 40 000+ entreprises accompagnées